Za kilka godzin opublikowany zostanie kolejny raport z amerykańskiego rynku pracy. Kluczową częścią tego raportu będzie zmiana (netto) miejsc pracy w sektorze poza-rolniczym. Komentatorzy i dziennikarzy wyjaśniać będą sytuację na rynku reakcją inwestorów na opublikowane dane.

Dlatego chciałbym zwrócić uwagę na pewien ignorowany fakt – podane za kilka godzin dane za listopad będą danymi wstępnymi. Zostaną dwukrotnie zrewidowane – w styczniu i w lutym. Następnie zostaną jeszcze kilkakrotnie (nawet pięciokrotnie dla danych dostosowanych sezonowo) zrewidowane przy okazji corocznej, lutowej rewizji benchmarku.

Rozsądny inwestor może zadać sobie pytanie: dlaczego kilkudziesięciotysięczne odchylenie od prognoz danych, o marginesie błędu na poziomie 100 000, które będą jeszcze 7 razy poddawane rewizji jest powodem gwałtownych ruchów na rynku? Margines błędu w danych NFP wynika z błędu próby – dane NFP powstają na podstawie bardzo rozbudowanego, obejmującego około 1/3 wszystkich zatrudnionych sondażu.

Coroczne rewizje odzwierciedlają rzeczywiste dane dotyczące zatrudnienia zebrane w związku z opłatami składek ubezpieczenia od bezrobocia. Rewizje w pierwszym i drugim miesiącu po wstępnych danych odzwierciedlają napływające po terminie odpowiedzi od uczestników sondażu, którymi w przypadku NFP, są podmioty gospodarcze (a nie gospodarstwa domowe).

Oczywiście wszystkie te informacje dostępne są na stronie zbierającego dane o amerykańskim rynku pracy Bureau of Labor Statistics (BLS). Zobaczcie: tutaj, tutaj i tutaj.

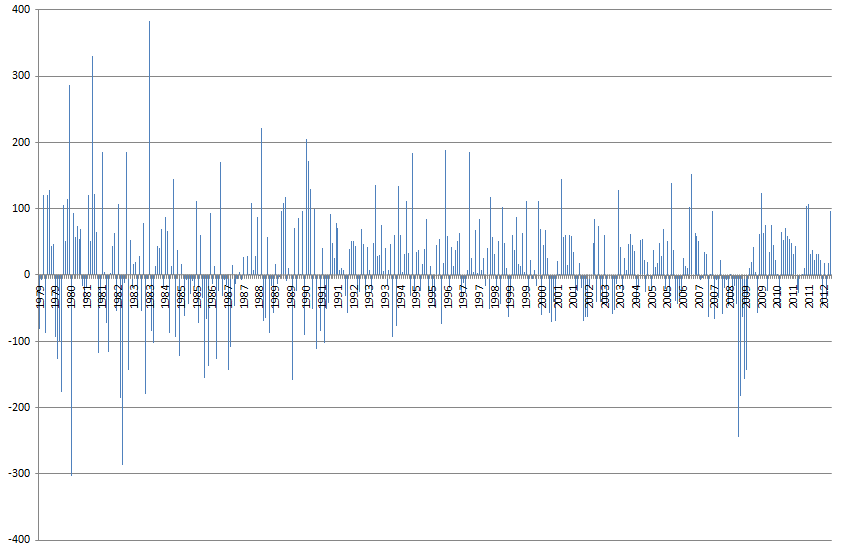

Dziś chciałbym zwrócić uwagę na najprostszy mechanizm rewidowania danych, miesięczne rewizje w dwóch kolejnych miesiącach po danych wstępnych. Poniższy wykres pokazuje wartość całkowitych rewizji (a więc różnicę pomiędzy danymi wstępnymi a danymi ostatecznie zrewidowanymi dwa miesiące później). Pozytywna wartość oznacza, że dane zrewidowano w górę.

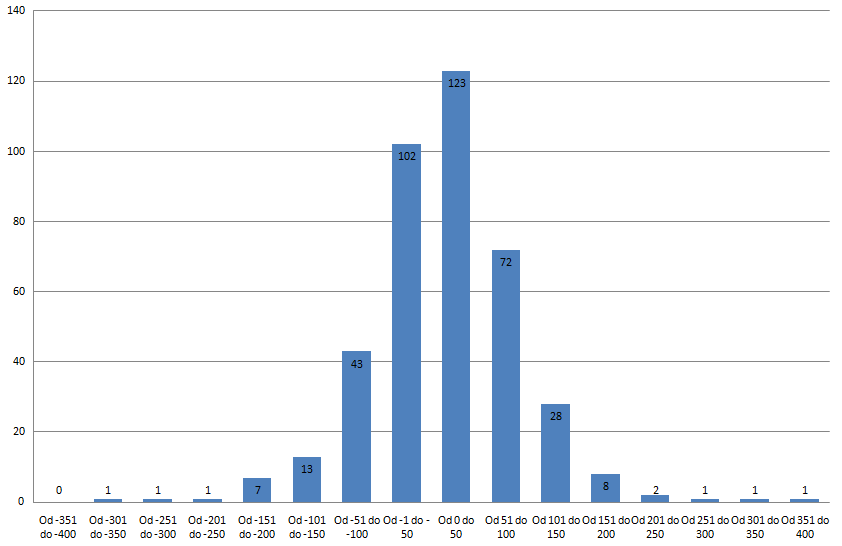

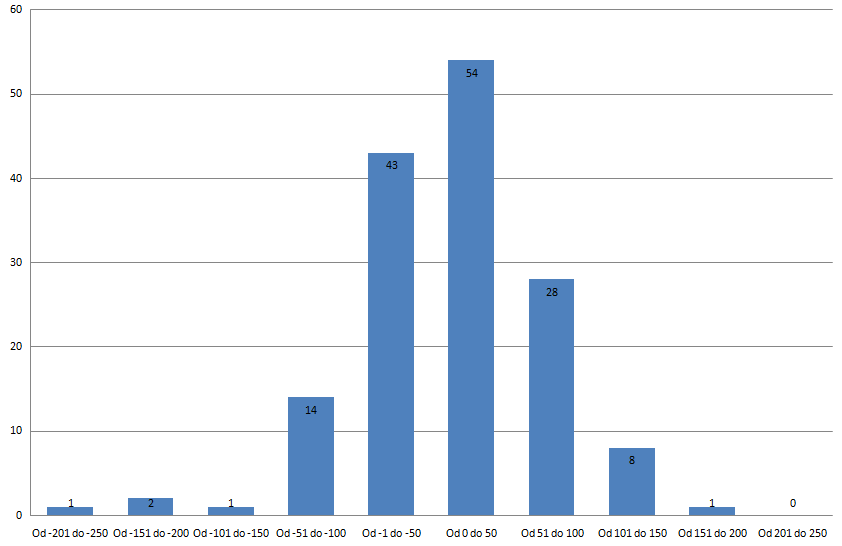

Te same dane można przedstawić w innych sposób – pokazujący częstość występowania rewizji w poszczególnych przedziałach, co 50 000 miejsc pracy.

Dane od 1979 roku:

Dane od 2000 roku:

Zauważcie, że wbrew popularnym teoriom spiskowym dane były częściej rewidowane w górę. Przeciętna rewizja wyniosła około 13 000 od 1979 roku i 10 000 od 2000 roku (to średnie z wszystkich rewizji: w górę i w dół).

Teoretycznie, można zbudować z tych zestawień przedział ufności – jeśli założymy, że dane po drugiej rewizji są ostateczne i odzwierciedlają realne zmiany zatrudnienia (to nie jest słuszne założenie – to ciągle są dane sondażowe). Zaciekawionym czytelnikom podam, że od 2000 roku 90% wstępnym danych mieściło się w przedziale plus albo minus 84 000, czyli 90% wstępnych danych było ostatecznie rewidowanych o mniej niż 84 000.

Powstaje pytanie jak duże są rewizje w kontekście publikowanych danych o miesięcznej zmianie (netto) miejsc pracy w sektorze pozarolniczym? Od 2000 przeciętna miesięczna zmiana NFP wyniosła około 150 000 – to średnia z wartości bezwzględnych publikowanych danych. Przeciętna wartość bezwzględna rewizji wyniosła w tym okresie około 46 000.

Relatywną wielkość rewizji można zmierzyć zestawiając je z różnicami pomiędzy konsensusem prognoz a opublikowanymi wstępnymi danymi (a więc wielkością, która zgodnie z mediami biznesowymi ma decydować o zachowaniu inwestorów). Napotkałem spore trudności w budowie bazy danych konsensusu prognoz – udało się mu zbudować dane dla okresu od maja 2009 (dane głównie z kalendarium Bossy). Co się okazało?

W tym okresie przeciętna wartość bezwzględna rewizji wynosiła około 44 000 miejsc pracy. Przeciętne bezwzględne odchylenie konsensus prognoz od wstępnych danych wyniosło 62 000 (od ostatecznych danych, po drugiej rewizji około 70 000)

Gdybyśmy po raz kolejny założyli (niesłusznie), że dane po drugiej rewizji to dane ostateczne a dane wstępne i konsensus prognoz to dwa rodzaje prognoz to moglibyśmy sprawdzić, które z tych prognoz są skuteczniejsze. Jak łatwo się domyśleć, wstępne dane NFP są lepszą prognozą – tak przynajmniej sugeruje pierwiastek z błędu średniokwadratowego (42 000 do 82 000).

7 Komentarzy

Dodaj komentarz

Niezależnie, DM BOŚ S.A. zwraca uwagę, że inwestowanie w instrumenty finansowe wiąże się z ryzykiem utraty części lub całości zainwestowanych środków. Podjęcie decyzji inwestycyjnej powinno nastąpić po pełnym zrozumieniu potencjalnych ryzyk i korzyści związanych z danym instrumentem finansowym oraz rodzajem transakcji. Indywidualna stopa zwrotu klienta nie jest tożsama z wynikiem inwestycyjnym danego instrumentu finansowego i jest uzależniona od dnia nabycia i sprzedaży konkretnego instrumentu finansowego oraz od poziomu pobranych opłat i poniesionych kosztów. Opodatkowanie dochodów z inwestycji zależy od indywidualnej sytuacji każdego klienta i może ulec zmianie w przyszłości. W przypadku gdy materiał zawiera wyniki osiągnięte w przeszłości, to nie należy ich traktować jako pewnego wskaźnika na przyszłość. W przypadku gdy materiał zawiera wzmiankę lub odniesienie do symulacji wyników osiągniętych w przeszłości, to nie należy ich traktować jako pewnego wskaźnika przyszłych wyników. Więcej informacji o instrumentach finansowych i ryzyku z nimi związanym znajduje się w serwisie bossa.pl w części MIFID: Materiały informacyjne MiFID -> Ogólny opis istoty instrumentów finansowych oraz ryzyka związanego z inwestowaniem w instrumenty finansowe.

Trystero co o tym sądzisz ?

kreatywna księgowośc na miarę Enronu ?

http://wyborcza.biz/Gieldy/1,114507,13000256,Deutsche_Bank_ukryl_12_mld_dol__straty_.html

@ miś

Bez wątpienia to ważna wiadomość i będę śledził rozwój sytuacji.

Na miarę Enronu to jednak chyba nie jest bo po uspokojeniu się sytuacji rynkowej DB zdołał wyjść z kontrowersyjnych pozycji.

Warto zwrócić uwagę na „pokręcony” wniosek, który z tej historii można wyciągnąć. Wniosek, co trzeba dodać, determinowany przez hindsight bias. Otóż, z informacji wynika, że DB ukrył te straty poprzez „księgowanie życzeniowe” ale po uspokojeniu się sytuacji rynkowej zdołał wyjść z tych pozycji. Jeśli to prawda, to DB, w tym konkretnym wypadku, skorzystał na tym, że nie stosował wyceny-do-rynku. Myślę, że przeciwnicy mark-to-market będą wykorzystywać ten przykład.

@ miś

Zobacz co Salmon napisał o tej sprawie

Sprawa nie jest tak oczywista jak przedstawia ją część mediów.

@ miś

A teraz z drugiej strony. Głos krytyczny wobec opinii Salmona.

Na danych nie polega się – dane się wykorzystuje.

Salmon wyjaśniając co to jest gap risk w tej sprawie, wyrażnie zboczył z kursu, rzekomo upraszczajac sprawę, bo zagubił potencjalną istotę sprawy.

Trystero link nie działa i wykazuje błąd 404 !!

@ lesserwisser

Poprawiłem. Coś mi się ucięło w adresie.